इस बात की कभी संभावना नहीं थी कि Apple “AI” को उतना ही बुदबुदाएगा जितना कि Google या Microsoft हाल ही में एक मुख्य वक्ता के रूप में करते हैं। या चैटबॉट लॉन्च करें, सिर्फ इसलिए कि हर कोई है। लेकिन जो कोई भी महसूस करता है कि कंपनी कृत्रिम बुद्धिमत्ता (एआई) पर उतना ध्यान केंद्रित नहीं कर रही है, जितना कि अन्य बड़ी तकनीक पर, WWDC 2023 के विकास को उन संदेहों को समाप्त करना चाहिए। Apple ने, iOS, iPadOS और macOS के अगले संस्करणों के साथ-साथ कई ऐप जिन्हें बड़े पैमाने पर फिर से काम किया गया है, ने AI को काफी हद तक लागू किया है। और फिर Apple विजन प्रो संवर्धित वास्तविकता (AR) हेडसेट है जिसके लिए कुछ न्यूरल नेटवर्क स्मार्ट की भी आवश्यकता होती है।

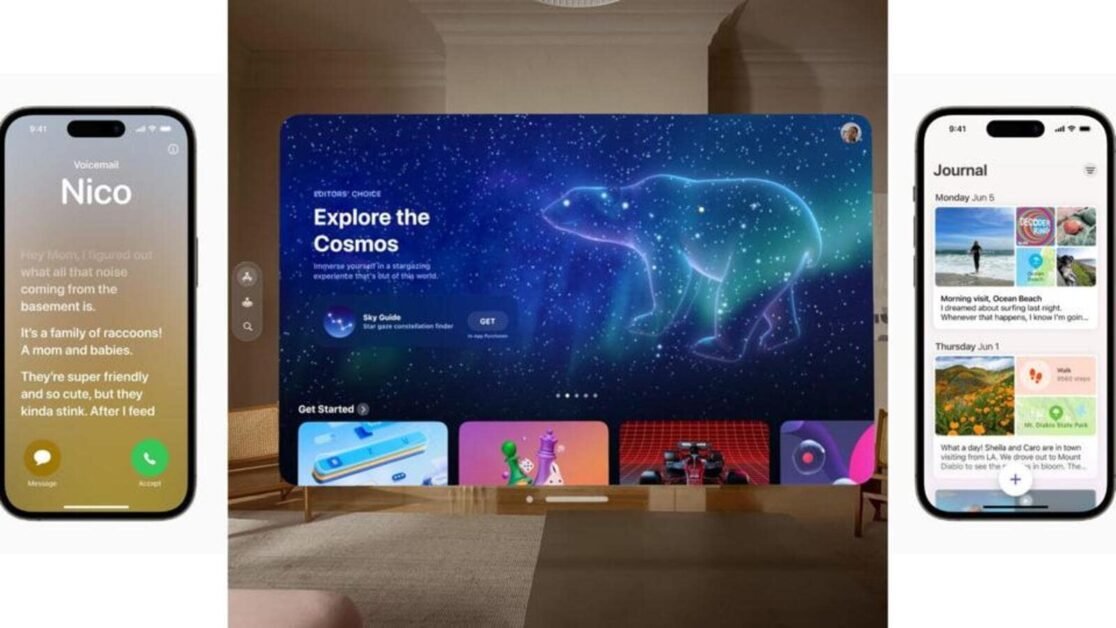

IPhone के लिए अगला ऑपरेटिंग सिस्टम, जिसे iOS 17 कहा जाता है (और यह इस साल के अंत में शुरू हुआ) Apple के अपने कुछ ऐप पर फिर से काम कर रहा है। उनमें से एक फ़ोन ऐप और विशेष रूप से ध्वनि मेल सुविधा है। यदि आप पहले से इसका उपयोग नहीं करते हैं, तो यह आपको मना सकता है – आपके लिए छोड़े जा रहे किसी भी ध्वनि मेल संदेश के लिए एक लाइव ट्रांसक्रिप्शन उपलब्ध होगा, और यदि आपको अभी भी लगता है कि यह महत्वपूर्ण है, तो आप किसी भी समय कॉल उठा सकते हैं संदेश वितरण और प्रतिलेखन प्रक्रिया के दौरान। Apple का कहना है कि डिवाइस पर ट्रांसक्रिप्शन होता है।

यह भी पढ़ें: जैसा कि Microsoft AI के साथ बनाता है, भारत के लिए चैटबॉट व्यापक सामुदायिक फोकस का संकेत देता है

यदि अभी भी कोई आशंका बनी हुई है, तो प्राकृतिक भाषा मॉडल का उपयोग आने वाले ऑटो-सुधार में सुधार के साथ चल रहा है, नए शब्द और व्याकरण पर ध्यान देने के साथ वाक्य स्वत: सुधार, आवाज टाइपिंग के लिए नया वाक् पहचान स्थानांतरण मॉडल, आगामी के साथ iMessage में एक वॉयस मैसेज के ट्रांसक्रिप्शन, नया जर्नल ऐप जो स्मार्ट सुझावों के लिए संदर्भ का उपयोग करेगा, समय और संदर्भ के लिए स्टैंडबाय मोड और मशीन लर्निंग (ML) का उपयोग करके iPadOS के आगामी में और फ्रेम जोड़कर धीमी गति को संश्लेषित करने सहित सुविधाएँ लॉक स्क्रीन अनुकूलन।

क्या यह “डकिंग” के युग का अंत है? हम जल्द ही जान जाएंगे।

Apple के AirPods वायरलेस ईयरबड्स जल्द ही अनुकूली ऑडियो तकनीक को जोड़ेंगे, जो मशीन लर्निंग का उपयोग करके उपयोगकर्ता के वर्तमान (और अक्सर तेजी से बदलते) वातावरण को गतिशील रूप से पारदर्शिता और स्वचालित शोर रद्द करने के लिए डिकोड करेगा। यदि आप ए में हैं [public transport for instance, just enough transparency (for those specific frequencies) will be enabled, so you don’t miss any announcements.

How well the Adaptive Audio feature works, and across different noise levels and noise compositions, we will know in due course once the feature rolls out and we use it extensively. Theoretically, if someone comes to speak with you, their voice will filter through to you, but it is likely a lot of the ambient din will remain blocked out. At least that’s the premise.

For the visionOS driven Apple Vision Pro headset, AR is very reliant on AI and machine learning, to potentially deliver the immersion, privacy, and extensive experience it sets out to deliver. The OpticID technology, which will be the AR version of an iPhone’s FaceID biometric recognition and authorisation technology, will require complex algorithms to process iris data on the device. This will open access to the apps on visionOS, as well as enable App Store purchase authentication and Apple Pay transactions too.

Apple confirms that all camera data collected by the Apple Vision Pro headset, is also processed on device. Think about it – that is the data collected by 12 cameras, five sensors, and six microphones on the headset.

Last but not least is the Journal app, which will be released with iOS 17. As the name suggests, it is a journaling app, which the tech giant sees as a wellbeing extension for the Fitness, Sleep and Breathe apps. It’ll use extensive algorithms to collect data from a user’s contacts, photos, music, location data and more, to curate personalised suggestions – though what can be accessed to curate suggestions, is fully controllable for the user.

It was never likely that Apple would have announced a chatbot, something like OpenAI’s ChatGPT or Google’s Bard, at WWDC 2023. Expectation from many, particularly the conversations on social media, seemed to hope for that. But Apple’s path was always going to be different. One where AI lends an underlying smartness to the experience of using an app or a feature. One where AI isn’t the center of attention, but a means to an end. With the examples we have pointed out, it is safe to assume that it is mission successful. At least as far as laying the foundations is concerned.