चैटजीपीटी का नवीनतम संस्करण कृत्रिम सामान्य बुद्धि के संकेत दिखाता है; विभिन्न क्षेत्रों में उपन्यास और कठिन कार्यों को एक तरह से मानव-स्तर के प्रदर्शन के करीब हल कर सकता है

Microsoft के एक नए अध्ययन में पाया गया है कि OpenAI के ChatGPT, GPT-4 के अधिक शक्तिशाली संस्करण को मनुष्यों की तरह तर्क करने और सामान्य ज्ञान का उपयोग करने के लिए प्रशिक्षित किया जा सकता है।

GPT-4 आर्टिफिशियल जनरल इंटेलिजेंस (AGI) की दिशा में एक महत्वपूर्ण कदम है और विश्लेषण में पाया गया है कि यह तर्क, योजना और उसी स्तर पर अनुभव से सीख सकता है जैसा मनुष्य करते हैं, या संभवतः उनसे ऊपर।

एआई बड़े भाषा मॉडल (एलएलएम) के एक नए समूह का हिस्सा है, जिसमें चैटजीपीटी और गूगल के पीएएलएम शामिल हैं। एलएलएम को भारी मात्रा में डेटा में प्रशिक्षित किया जा सकता है और उत्तरों के साथ आने के लिए इमेज और टेक्स्ट दोनों को फीड किया जा सकता है।

Microsoft ने OpenAI में अरबों डॉलर का निवेश किया और सार्वजनिक रूप से लॉन्च होने से पहले इसकी पहुंच थी। कंपनी ने हाल ही में 155 पन्नों का एक विश्लेषण निकाला, आर्टिफिशियल जनरल इंटेलिजेंस की चिंगारी: GPT-4 के साथ शुरुआती प्रयोग।

GPT-4 का उपयोग Microsoft की बिंग चैट सुविधा को सशक्त बनाने के लिए भी किया जाता है।

शोध दल ने पाया कि एलएलएम को मनुष्यों की तरह तर्क करने और सामान्य ज्ञान का उपयोग करने के लिए प्रशिक्षित किया जा सकता है। उन्होंने प्रदर्शित किया कि GPT-4 गणित, दृष्टि, चिकित्सा, कानून और मनोविज्ञान सहित विशेष प्रोत्साहन के बिना कई क्षेत्रों में जटिल कार्यों को हल कर सकता है।

माइक्रोसॉफ्ट ने कहा कि जनता के लिए उपलब्ध सिस्टम उतना शक्तिशाली नहीं है जितना उन्होंने परीक्षण किया था।

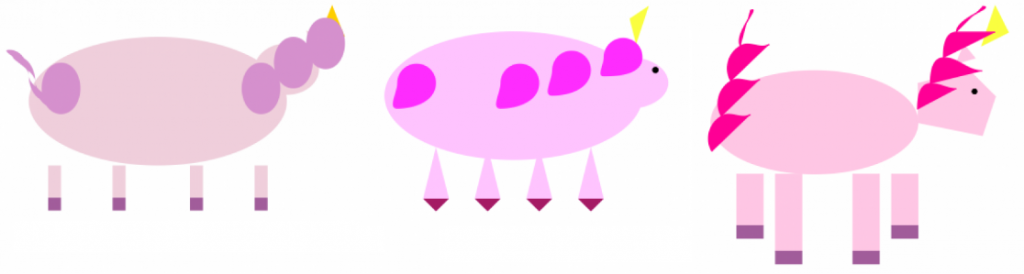

पेपर ने कई उदाहरण दिए कि एआई अवधारणाओं को कैसे समझता है, जैसे कि यूनिकॉर्न क्या है। GPT-4 ने TiKZ नामक उप प्रोग्रामिंग भाषा में एक यूनिकॉर्न बनाया। कच्चे “चित्र” में, GPT4 को एक गेंडा अधिकार की अवधारणा मिली।

सच्ची सीख और याद रखने के बीच के अंतर को प्रदर्शित करने के लिए, शोधकर्ताओं ने GPT-4 को एक महीने के दौरान तीन बार ‘TikZ में एक गेंडा बनाने’ के लिए कहा। एआई ने चित्रों के परिष्कार में एक स्पष्ट विकास दिखाया। स्रोत: माइक्रोसॉफ्ट

OpenAI ने कहा कि GPT-4 ने पिछले मॉडल की तुलना में अधिक सामान्य ज्ञान का प्रदर्शन किया, जैसे कि ChatGPT। GPT-4 और ChatGPT दोनों को एक किताब, नौ अंडे, एक लैपटॉप, एक बोतल और एक कील रखने को कहा गया।

जबकि चैटजीपीटी ने अंडों को नाखून के ऊपर रखने की सिफारिश की, अधिक परिष्कृत मॉडल ने वस्तुओं को व्यवस्थित किया ताकि अंडे टूट न जाएं।

और पढ़ें: थर्टी एआई: चैटजीपीटी 20-50 सवालों के जवाब देने के लिए आधा लीटर ताजा पानी पीता है, अध्ययन कहता है

हालाँकि, रिपोर्ट ने स्वीकार किया कि AI की अभी भी सीमाएँ और पूर्वाग्रह हैं और उपयोगकर्ताओं को सावधान रहने की चेतावनी दी गई थी। GPT “अभी भी पूरी तरह से विश्वसनीय नहीं है” क्योंकि यह अभी भी “भ्रम” करता है और तर्क और बुनियादी अंकगणितीय त्रुटियां करता है।

विश्लेषण पढ़ता है:

जबकि GPT-4 कई कार्यों के लिए मानव-स्तर पर या उससे परे है, कुल मिलाकर, इसकी बुद्धि के पैटर्न निश्चित रूप से मानव-समान नहीं हैं। हालाँकि, GPT-4 लगभग निश्चित रूप से आम तौर पर बुद्धिमान प्रणालियों की एक श्रृंखला की दिशा में केवल पहला कदम है, और वास्तव में, GPT-4 ने हमारे परीक्षण के दौरान ही इसमें सुधार किया है।

हालांकि, कागज ने उपयोगकर्ताओं को सावधान रहने की चेतावनी दी, इसकी सीमाओं जैसे आत्मविश्वास अंशांकन, संज्ञानात्मक भ्रम और तर्कहीनता और इनपुट के प्रति संवेदनशीलता के साथ चुनौतियों की चेतावनी दी।

“भाषा मॉडल आउटपुट का उपयोग करते समय बहुत सावधानी बरती जानी चाहिए, विशेष रूप से उच्च-दांव वाले संदर्भों में, सटीक प्रोटोकॉल के साथ (जैसे कि मानव समीक्षा, एक अतिरिक्त संदर्भ के साथ ग्राउंडिंग या उच्च-दांव का उपयोग पूरी तरह से टालना) एक विशिष्ट उपयोग की जरूरतों से मेल खाता है- मामला, “यह कहा।

और पढ़ें:

हम आपके लिए एक आवाज हैं; आप हमारे लिए एक समर्थन रहे हैं। हम सब मिलकर ऐसी पत्रकारिता का निर्माण करते हैं जो स्वतंत्र, विश्वसनीय और निडर हो। आप आगे दान करके हमारी मदद कर सकते हैं । जमीनी स्तर से समाचार, दृष्टिकोण और विश्लेषण लाने की हमारी क्षमता के लिए यह बहुत मायने रखता है ताकि हम मिलकर बदलाव ला सकें।